Wprowadzenie do przełączania i routingu

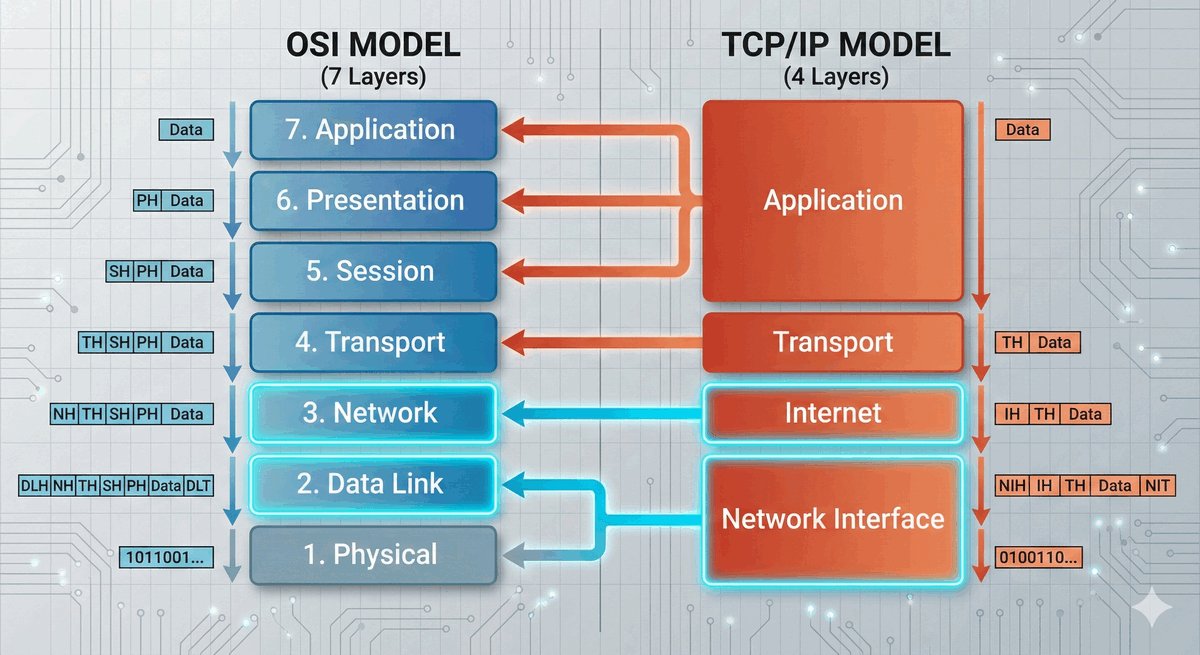

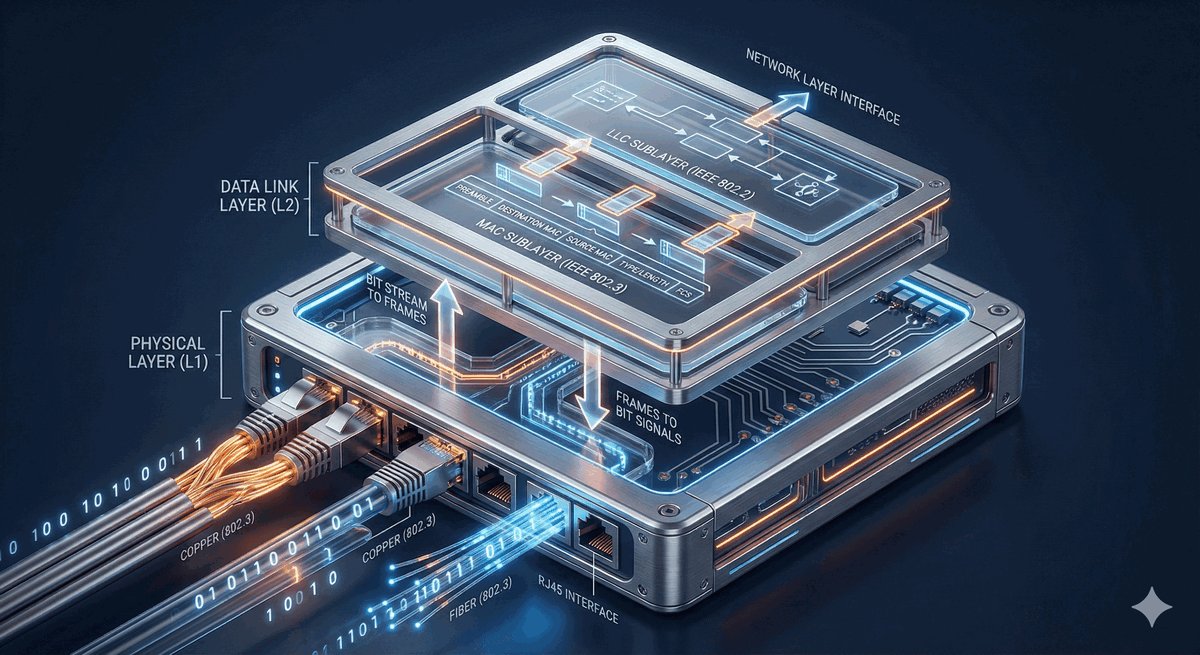

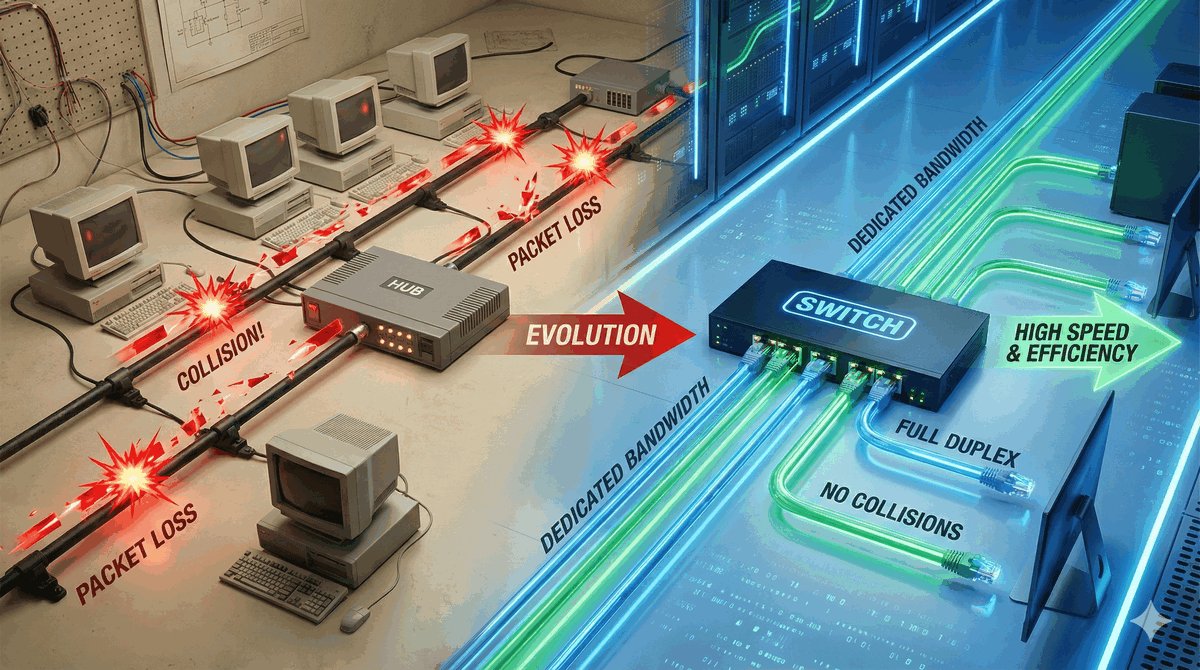

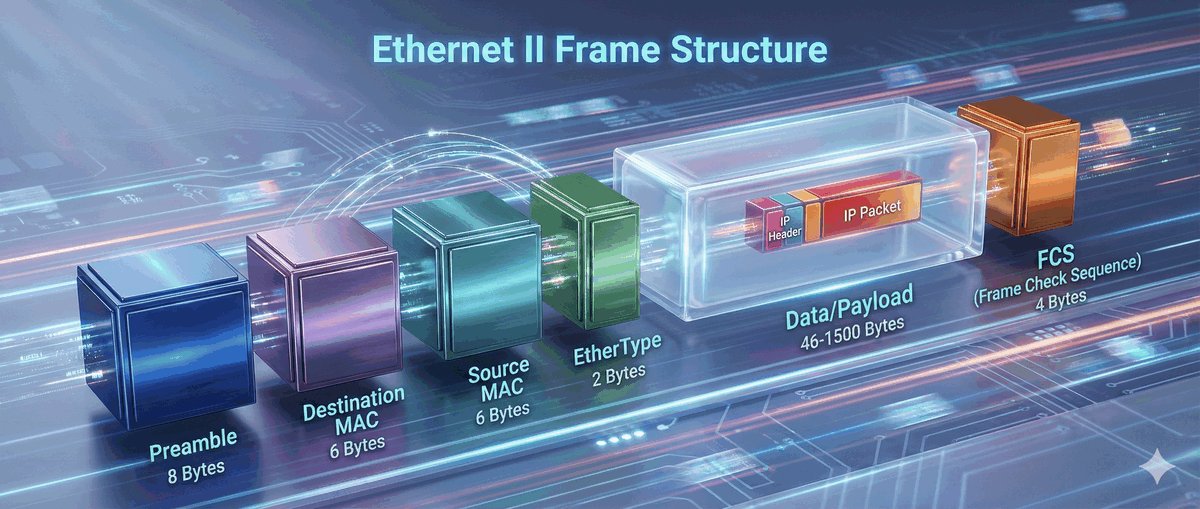

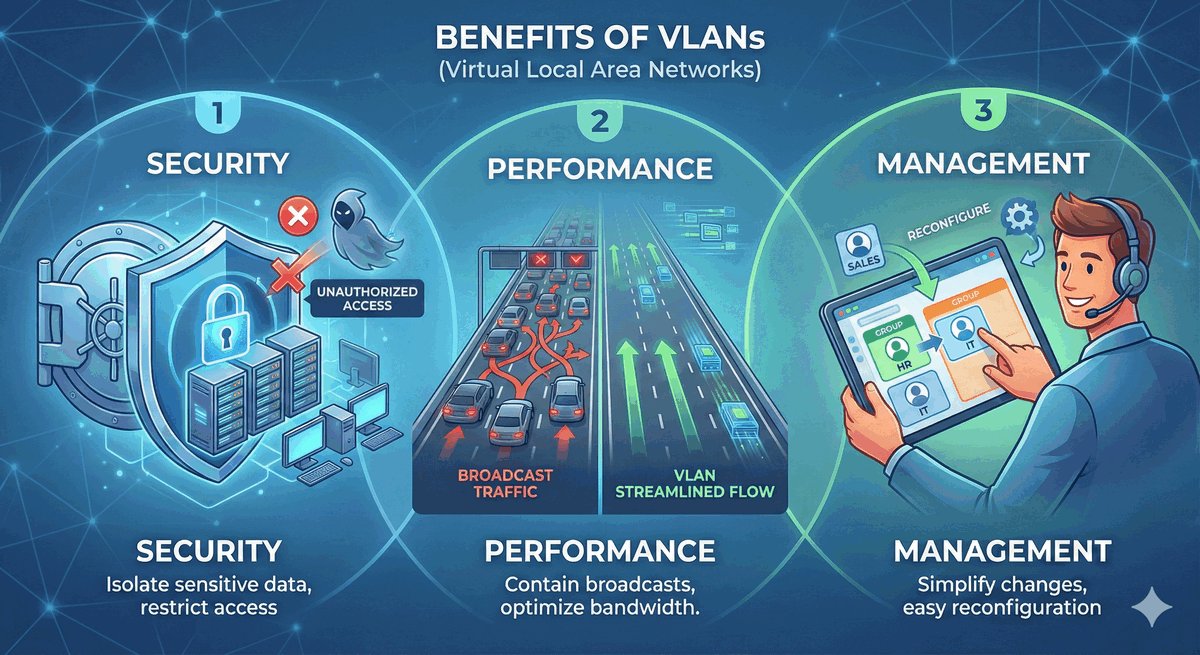

1/35Ten wykład ma na celu przedstawienie podstawowych pojęć związanych z przełączaniem i routingiem w sieciach komputerowych. Skupimy się na technologiach i protokołach działających w warstwie drugiej i trzeciej modelu OSI, co jest kluczowe dla zrozumienia budowy i zarządzania nowoczesnymi sieciami. Podczas spotkania omówimy ewolucję technologii Ethernet, zasady działania przełączników, podstawy adresowania oraz strukturę ramki Ethernet, a na koniec wprowadzimy koncepcję wirtualnych sieci lokalnych (VLAN).

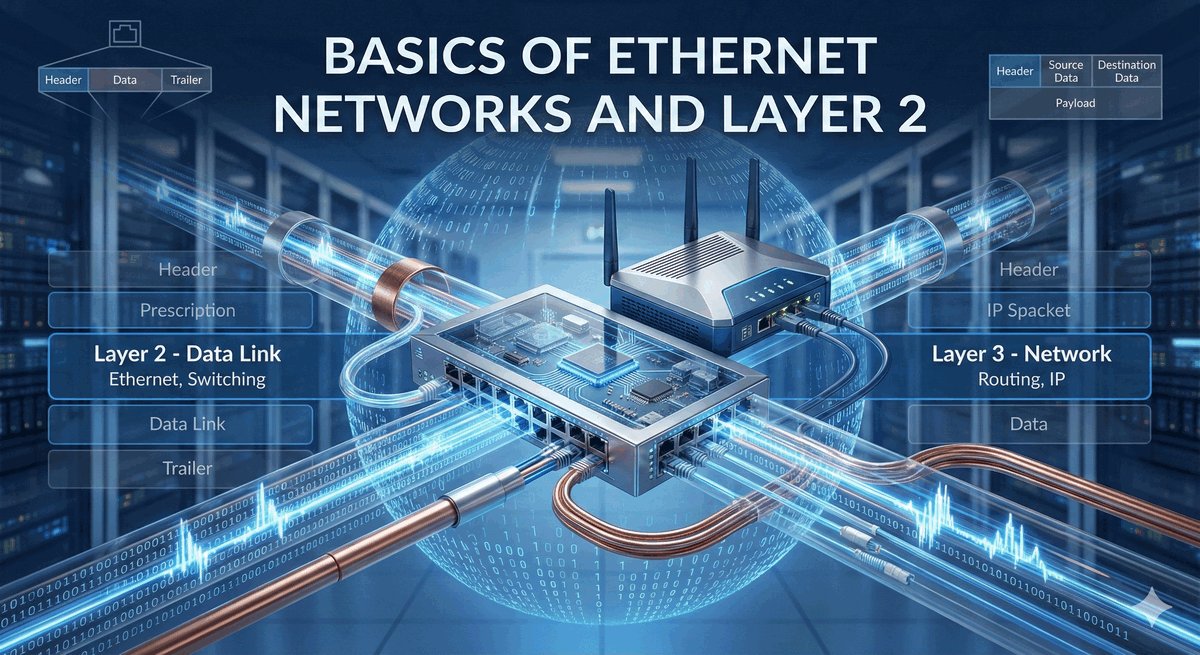

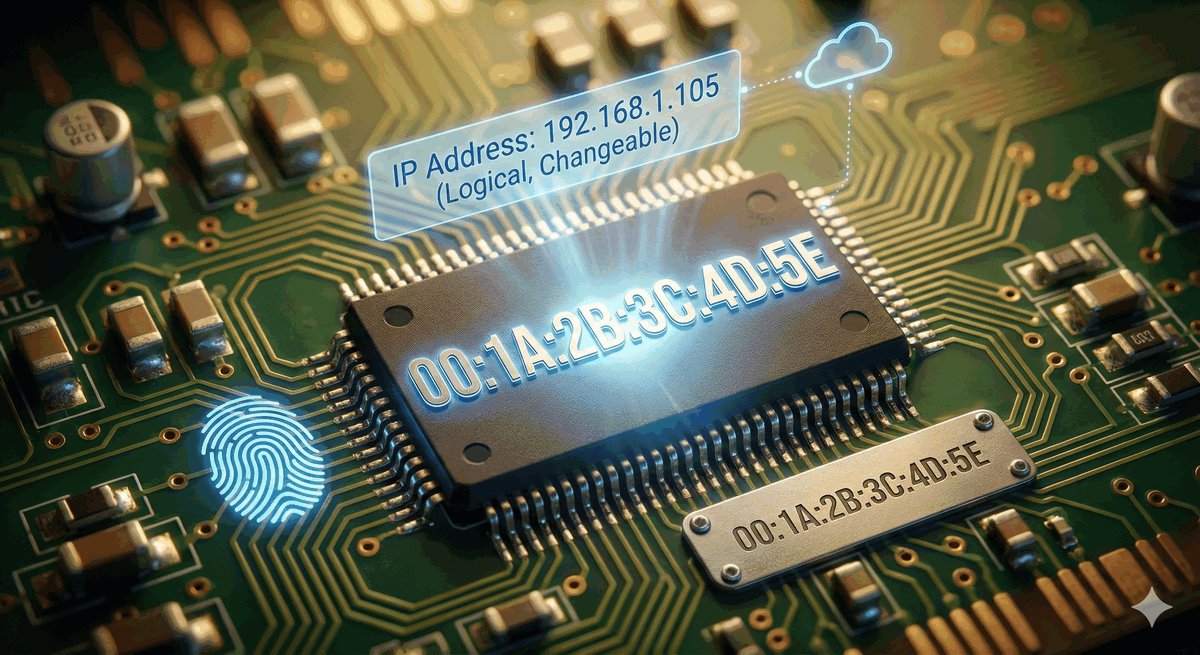

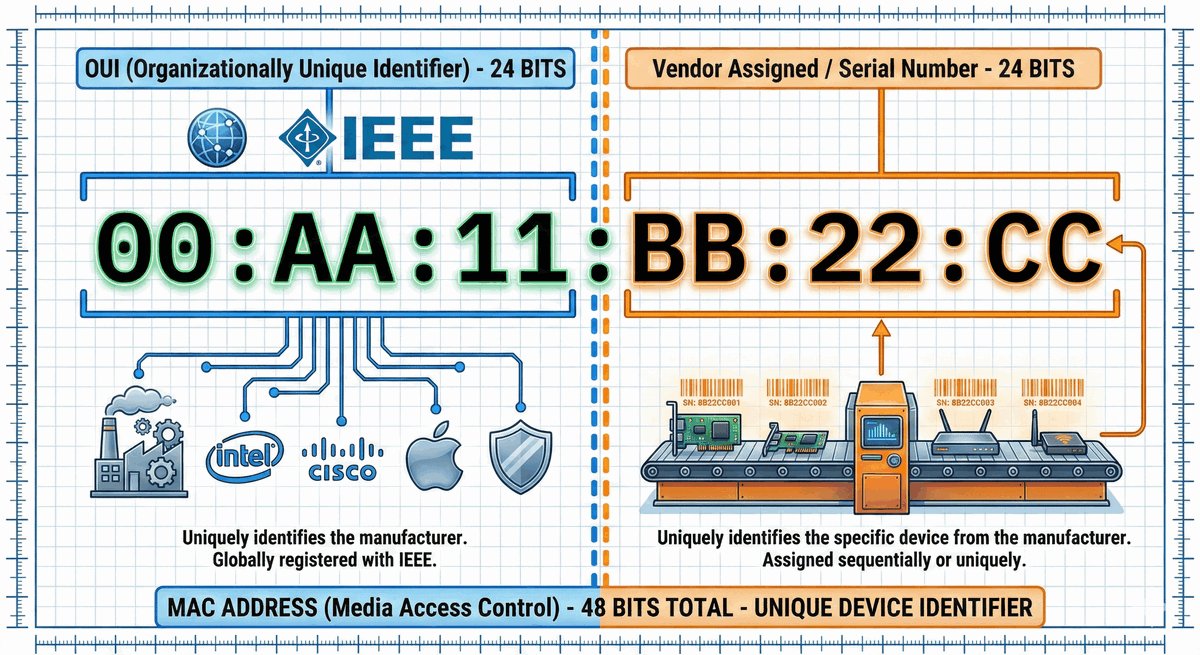

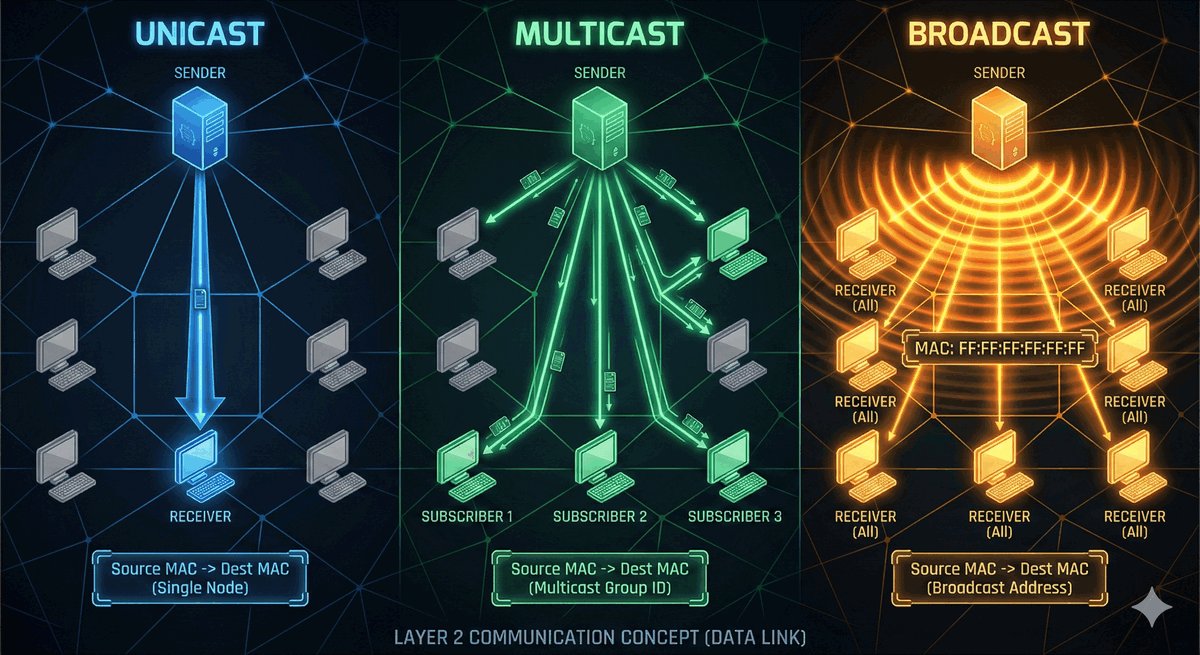

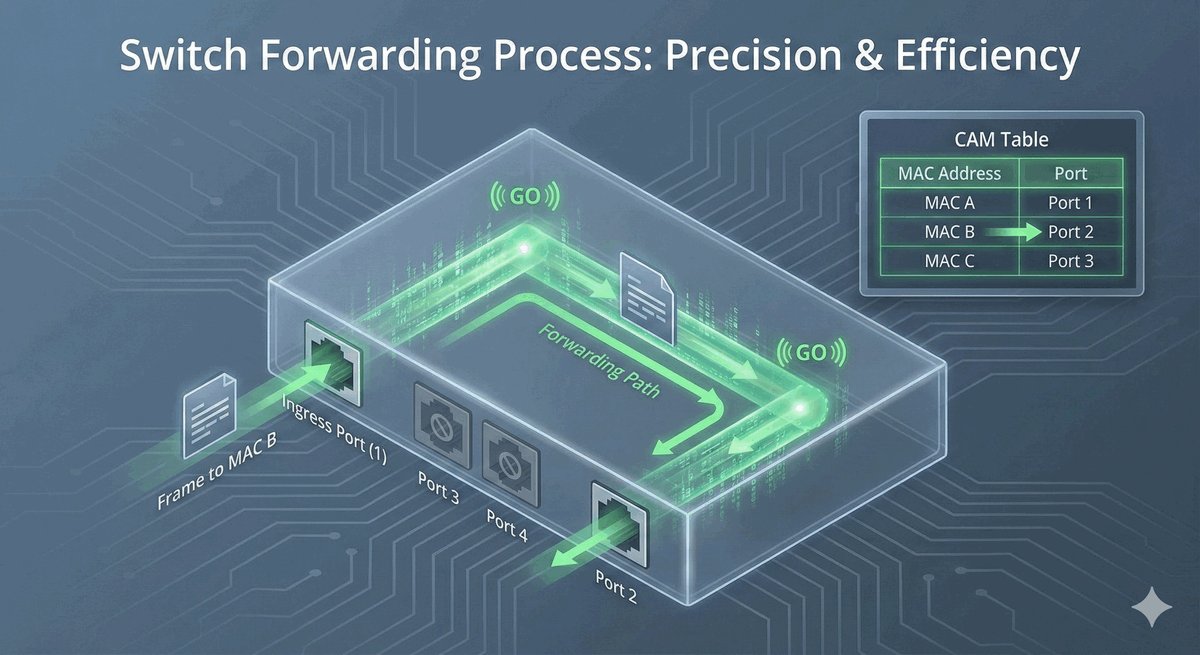

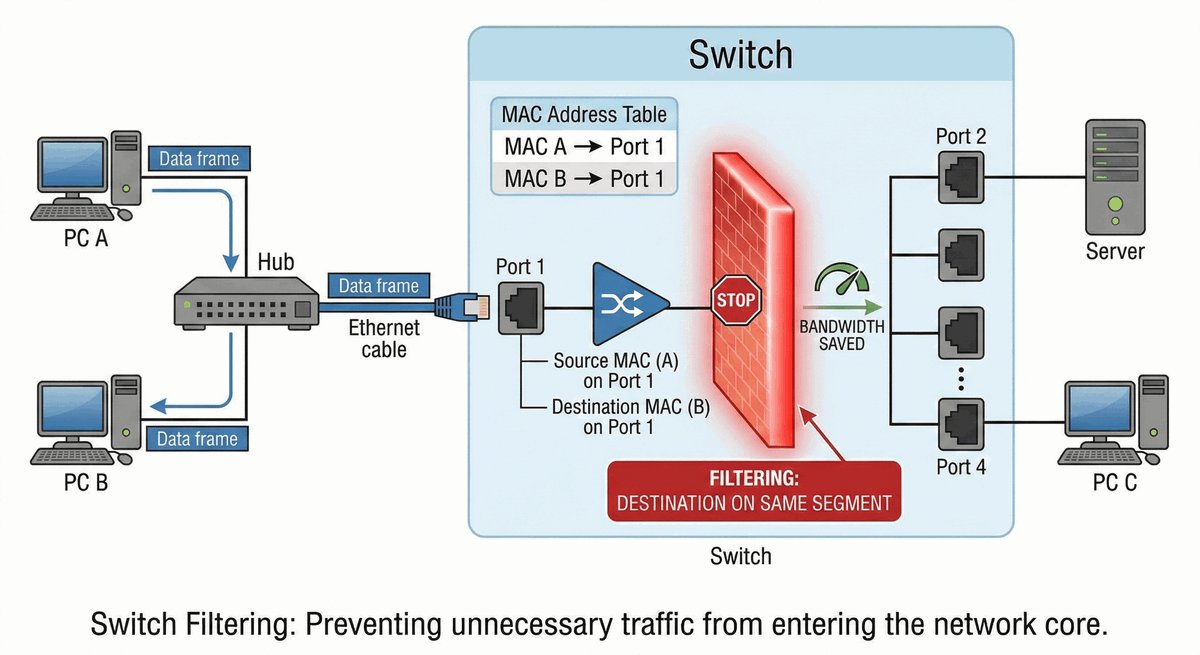

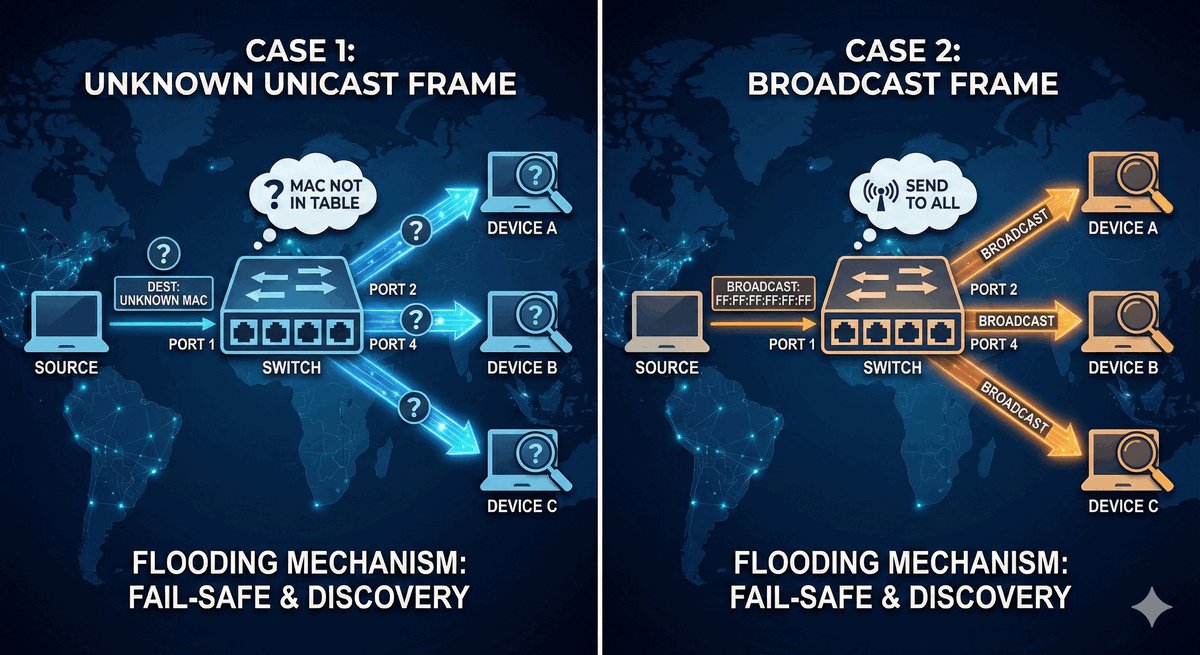

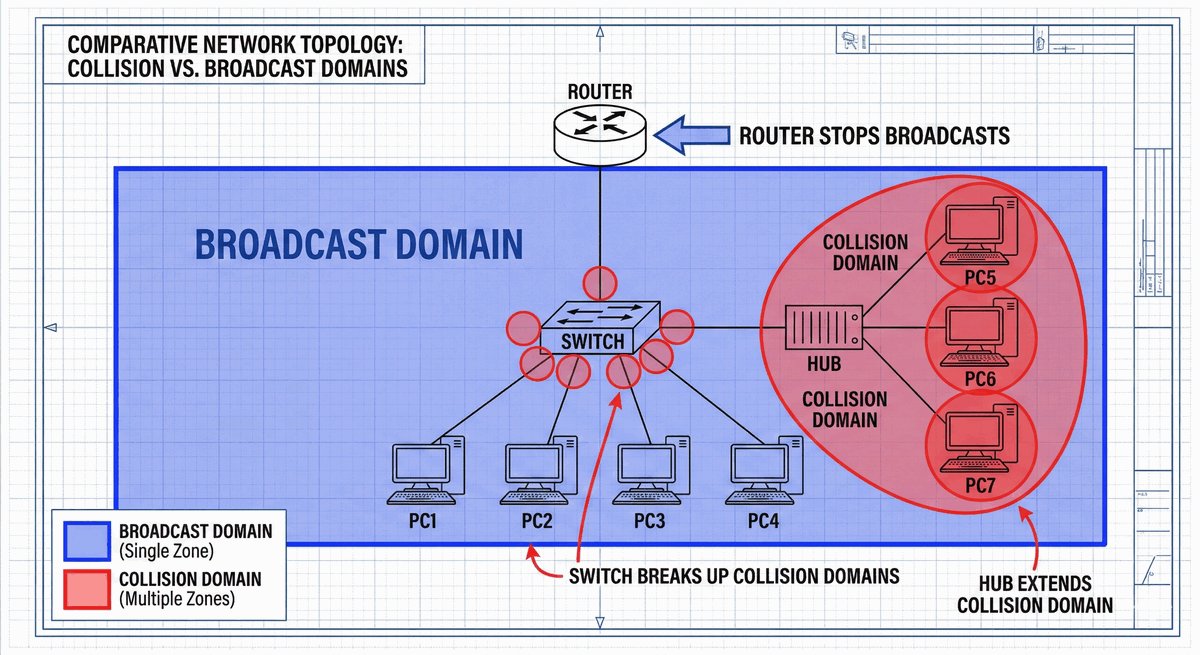

Zdefiniujemy kluczowe pojęcia: przełączanie (switching), czyli proces przekazywania danych w sieci lokalnej na podstawie adresów MAC, oraz routing, czyli wyznaczanie ścieżek dla danych pomiędzy różnymi sieciami przy użyciu adresów IP. Po ukończeniu wykładu będziesz w stanie wyjaśnić działanie tych mechanizmów, co stanowi solidną podstawę do dalszego rozwoju w dziedzinie administracji sieciami. Wiedza ta ma bezpośrednie zastosowanie praktyczne, ponieważ omawiane technologie są powszechne w każdej sieci, od domowych po globalne centra danych, i są niezbędne do rozwiązywania codziennych problemów z łącznością.